从“抽卡”到“成片”:Seedance 2.0重构视频创作?

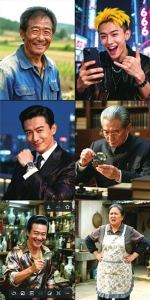

字节跳动旗下AI模型生成的剧本人物照。受访者供图

用户排队试用等出片。“中国版sora”(文本和视频生成AI模型)——Seedance 2.0经过字节跳动海量视频数据的“投喂”,已经开始在业内刮起15秒短视频创作旋风。日前,华西都市报、封面新闻记者从相关人士处了解到,目前字节跳动旗下工作人员已经在给创作者推送Seedance 2.0使用手册。

“AI视频创作现在已经从幼儿园进化到了小学,迭代以天计算。”AIGC(人工智能生成内容)创作者刘归源告诉记者试用Seedance 2.0的体验。

“Seedance 2.0已经接近于一款工业化内容生产工具,在成本效率与稳定可控性上更具优势,适合商业内容批量生产。”四川大学中华文化传承与全球传播数字融合实验室执行主任宋耀说。

1

创新:双分支扩散架构

2月9日,字节跳动发布视频生成模型Seedance 2.0测试版,引发全网热议。

“你可以理解为,以前的AI是画家,现在Seedance是编剧+分镜师+摄影师三位一体。”宋耀说,过去两年,AI视频生成的最大痛点并非画质,而是连贯性。早期模型本质上是逐帧生成+简单拼接,每一帧独立绘制,再靠后期处理强行对齐。结果便是角色面孔随机变化、手指数目错乱、背景忽明忽暗——业内戏称“抽卡地狱”(抽卡类游戏用语)。“Seedance 2.0的突破,在于引入了所谓‘双分支扩散架构’。”宋耀解释说。

这个架构,本质上是在传统扩散模型上叠加了一个长期时序控制的大脑。而所谓“双分支”,可以通俗理解为一条分支负责画面生成,另一条分支负责整体叙事与时序控制。“前者仍然使用扩散模型来生成高质量图像帧,后者则承担‘导演’角色,负责记住人物身份、动作轨迹、镜头逻辑以及场景状态。”这种设计使模型不再是每一帧独立创作,而是在一个持续存在的状态中推进画面,因此角色不会在不同镜头中随机变脸,动作也能保持物理连续性,镜头切换时的空间关系与光线条件能够维持一致,从根本上缓解了早期AI视频常见的“画面崩坏”“角色漂移”“动作断裂”等顽疾。

2

从“抽卡”到快速出视频

四川传媒学院跨媒体艺术专业主任刘归源长期关注AIGC发展和应用。“每个大厂的模型都各有特点,我们通常是几种工具交替使用,配合不同模型,提升效率。”他坦言,在Seedance 2.0出来之前,做一条30秒的AI视频,实属“劳动密集工作”。“光是修图就得反复‘抽卡’,平均一张图要改4到5次,才能用。而一个几十秒的视频,背后可能要生成200到300张图,再手动筛选、拼接。整个流程特别繁琐——先写文字脚本,再分镜,然后出图,转视频,最后剪辑合成,要花几个小时。”

现在,只需要提供足量细节的提示词、有效的首尾帧画面,AI就能在短时间内生成一段运镜流畅、转场丝滑的短视频。刘归源展示了一个用Seedance 2.0生成的15秒动画,“整个时间差不多半个小时。”

如果说去年的AI出图水平还停留在“幼儿园级别”,现在Seedance 2.0一出,算是进阶到了“小学级别”。在刘归源看来,这还不是结束,“很快也会有其他厂牌超越它——这场AI视频战争,技术迭代是以‘天’为单位的。”

3

技术、数据造就“中国版sora”

“海外评测认为Seedance 2.0在角色一致性与多镜头叙事上优于sora 2,这一优势既来自架构设计,也来自训练数据结构。”宋耀补充说,“架构层面,Seedance显然更强调角色持久状态与镜头逻辑控制,而sora更强调物理世界模拟与场景生成,因此前者在人物驱动叙事上更稳定。”

“数据层面,中国短视频生态提供了海量连续剧情、口播与电商视频素材,这类内容天然具有角色连续、镜头密集与节奏明确的特征,使模型在训练中更容易学习到工业化叙事结构。可以说,技术与数据的双重因素共同造就了其在多镜头叙事上的优势。”宋耀分析。与此观点一致,刘归源把这次字节跳动在AI视频创作工具的暂时领先,归结于Seedance 2.0对字节旗下抖音等短视频平台海量数据的学习。

4

整体风格更偏向“内容生产流水线”

与其他模型不同,字节走出了工业风。

“从横向对比来看,Seedance 2.0与国际主流模型的定位差异十分明显。OpenAI推出的sora更偏向世界模拟与通用视频生成,其目标是构建能够理解物理世界与复杂场景的通用生成模型。”宋耀认为,Seedance 2.0的差异化定位则更接近工业化内容生产工具,尤其面向短视频、广告、电商与剧情短内容的高效生成,因此在角色稳定性、镜头可控性与音画同步方面投入更多架构优化。这也使Seedance 2.0的整体风格更偏向“内容生产流水线”,而非艺术实验型模型。

“在生成时长、分辨率与成本效率方面,Seedance 2.0大概率处于全球第一梯队,但偏工业应用。”宋耀评价说。其生成时长与分辨率可能略低于最激进的研究型模型,但在成本效率与稳定可控性上更具优势,适合商业内容批量生产。华西都市报-封面新闻记者 张峥